隨着ChatGPT帶火的AI熱潮持續升溫,行業內布局大型語言模型的企業逐漸增多,對算力的需求也在顯著提高。目前英偉達GPU價格不僅水漲船高,交貨周期也被拉長,部分新訂單可能要到12月才能交付。

A100價格漲幅達37.5%,A800價格漲幅達20%

據集微網消息,有代理商透露,英偉達A100價格從去年12月开始上漲,截至今年4月上半月,5個月價格累計漲幅達到37.5%;同期A800價格累計漲幅達20.0%。同時,英偉達GPU交貨周期也被拉長,之前拿貨周期大約爲一個月,現在基本都需要三個月或更長。甚至,部分新訂單“可能要到12月才能交付”。

供需的巨大鴻溝面前,在這一情形之下,衆多客戶也不得不“勒緊腰帶”。據集微網文章指出,國內可用於訓練AI大模型的A100大約有4萬-5萬個,供應相當喫緊,一些雲服務廠商已嚴格限制內部使用這些先進芯片,以將其保留至需要強力運算的任務。

值得一提的是,類似的事情在微軟內部也早已發生。3月已有外媒報道指出,微軟內部陷入AI服務器硬件短缺的窘境,不得不對AI硬件資源採取“配額供給”機制,限制公司內部其他AI工具开發團隊的資源用量。

英偉達GPU漲價始末

拉長時間线來看,有GPU業內人士指出,實際上從去年6月起,英偉達就已宣布上調A100價格,漲幅20%左右,渠道商在加緊囤貨。至於英偉達A800,在ChatGPT火爆之前就已出現漲價,但反映到市場則有一定的滯後性,趕上ChatGPT爆火這一時間點,更放大了這一現象。

GPU業內人士表示:“英偉達GPU漲價與ChatGPT有一定的關聯性,且交貨周期也受到了連帶的影響,導致市場上出現了衆多炒卡的行爲。”

此外,在海外電商平台上,英偉達新旗艦級GPU H100的價格在4月中旬就已炒到了超過4萬美元。

如今各家科技巨頭爭相推出自家大模型,GPU需求量持續攀升。OpenAI指出,AI大模型要持續取得突破,所需要消耗的計算資源每3~4個月就要翻一倍,資金也需要通過指數級增長獲得匹配。

業內人士也表示,AI大模型訓練成本之一是基礎算力,如果價格持續上漲,無論是互聯網、AI大廠、還是創業新貴,要追加的投入都可能遠超當初。

GPU築起大模型算力門檻

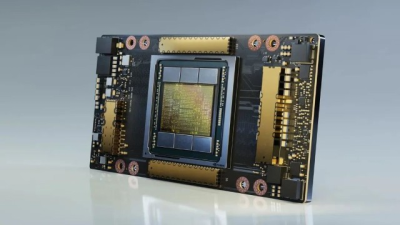

衆所周知,芯片能力直接影響着高算力訓練效果和速度,相較於基於CPU芯片的通用算力,AI所需的智能算力則主要基於GPU、GPGPU及AISC等AI芯片所提供算力,用於人工智能的訓練和推理。其中,GPU是一種專門用於處理圖形、視頻、遊戲等高性能計算的硬件設備,憑借相較於其他硬件在算力方面的較大優勢脫穎而出,同時隨着英偉達A100、H100等型號產品的發布,前款產品在AI推理時量是CPU的249倍。GPU已成爲當前AI算力的核心硬件。

中金公司研報表示,多GPU互聯能力加強可以提高並行計算能力,因而算力提升對GPU數量的要求日益提高。隨着單GPU的計算能力越來越難以應對深度學習對算力的需求,英偉達已經开始用多個GPU去解決問題。對此,業內分析認爲,高端GPU的數量基本決定了一個廠商能夠練多大的模型,後期將成爲業內判斷企業大模型能力的重要指標。

據TrendForce數據顯示,如果以英偉達 A100 顯卡的處理能力計算,GPT-3.5大模型需要2萬塊GPU來處理訓練數據。亦有業內公認看法,做好AI大模型的算力門檻是1萬枚A100芯片。

目前,全球GPU市場主要由英偉達、英特爾和AMD三家巨頭壟斷,去年Q4獨立GPU份額分別爲85%、6%、9%。其中,人工智能、雲端計算和獨立GPU主要爲英偉達主導,A100和H100最高浮點算力分別實現19.5 TFLOPS 和67 TFLOPS。

END

本文作者可以追加內容哦 !

鄭重聲明:本文版權歸原作者所有,轉載文章僅為傳播信息之目的,不構成任何投資建議,如有侵權行為,請第一時間聯絡我們修改或刪除,多謝。

標題:漲幅37%!英偉達GPU持續缺貨漲價!

地址:https://www.breakthing.com/post/58355.html