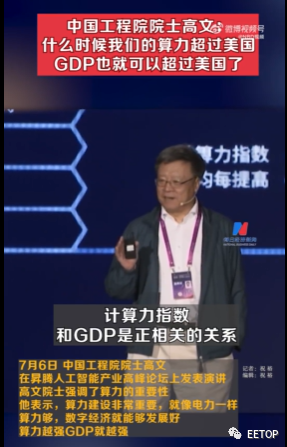

中國工程院院士:什么時候我們的算力超過美國,GDP也就可以超過美國了!

2023-07-09 10:27:03 來源:EETOP

7 月 7 日消息,中國工程院院士、鵬城實驗室主任高文在世界人工智能大會昇騰人工智能產業高峰論壇上演講時表示,沒有大算力做大模型就是天方夜譚,這就和電力是一樣的,可以省點電做出什么產品來,別人真正懂行的人聽了都不信的,一定要有算力作爲基礎。算力建設非常重要,就像電力一樣。

高文院士表示:“美國的算力現在指數是排第一,比我們大概多了 30% 的算力,那么也就代表 GDP 也比我們多 30%,什么時候我們的算力超過了美國,咱們的 GDP 就可以超過美國了。”

按照高文的說法,算力夠,數字經濟就能夠發展好,算力指數和GDP是正相關的關系,算力越強GDP就越強。

他表示,從現在开始,算力也是數字經濟發展的一個指數,算力夠,你的數字經濟就能夠發展好,不夠就發展不好。

以下爲高文演講全文:

各位專家、各位領導,大家下午好!

前面的領導都講得很好,算力是非常重要的一件事,今天上午陳書記在講的時候也講到,上要抓三件大事,人工智能方面其中就有一個是算力建設,算力建設非常重要的一方面,就像電力一樣。

從現在开始,算力也是數字經濟發展的一個指數,你算力夠,你的數字經濟就能夠發展好,不夠就發展不好。所以,特別是智能算力就非常關鍵。

所以跟大家分享關於鵬城雲腦的智算平台,再就是分享一下在這個平台上面做的鵬城腦海大模型。

首先,我們說算力很重要,重要到什么程度呢?

清華大學的一個 2022 年的咨詢報告說到了,經過統計計算力指數和 GDP 是正相關的關系,你算力越強你的 GDP 就越強,最右邊的圖可以看到,美國的算力現在指數是排第一,比我們大概多了 30% 的算力,那么也就代表 GDP 也比我們多 30%,什么時候我們的算力超過了美國,咱們的 GDP 就可以超過美國了。

正是因爲算力這么重要,所以發展人工智能和經濟沒有算力不可能,要有算力要有芯片,芯片做成機器,用這個機器訓練這個模型,爲了做這件事,我們在 2020 年深圳就做了一台機器,這台 機器叫鵬城雲腦 II,這台機器的算力在 2020 年的時候是全世界做人工智能訓練最強的一台機器,比當時微軟、谷歌的機器都要強,相當於是 4000 塊卡的機器,而且這台機器是 4000 塊 A100 卡的機器,這台機器是用全光網絡把它連起來的,節點和節點之間的延遲非常低。

因爲,有了這台機器可以做很多事,包括我們可以做科學研究,可以做產業應用還有關鍵技術的研發。

這台機器剛剛我說有 4000 塊卡,一個是鯤鵬 CPU,一個是昇騰 NPU,都是華爲的。

有了這台機器以後,那么這台機器的性能行不行呢?就參加世界 TOP500 的超算的打榜,整個超算整個算力的打榜,同時它也有其他的賽道,我們參加的一 個是 IO500 的賽道,你的輸出和輸入能力的賽道,我們從 2020 年 10 月份這台機器做出來以後,11 月份就參加打榜,連續 6 次第一,每半年有一次打榜,全節點連續二次第一。

所以,這台機器在做人工智能訓練這件事,別人沒辦法和它比。這台機器的 AI 算力,這個是三年一次的,也參加了打榜,連續三次第一。這台機器不僅硬件強,接口能力和網絡非常強,同時上面的軟件也是配備得比較完備,包括怎么樣做分布式計算,怎么樣做命令調優、自研的調度規劃等等。這台機器這么大規模的機器以前還是第一次,相當於它的四台機器,其實是四台我們的機器組成這一台了,上面有很多軟件的挑战。

可能有的專家也許聽到過,有人說全世界能在 1000 塊卡上同時選連一個模型的只有幾千人,能在 4000 塊卡上訓練的不超過 100 個人,在 10000 塊卡上訓練模型的人數更少了,大規模的卡上一起做事,對於軟件規劃、資源調度挑战非常大。

我們不僅僅是把鵬城雲腦 II 用好,我們也承擔了國家發改委的任務,用鵬城雲腦 II 類似的華爲生態的,用在昇騰 AI 集群,不管是 100P 和 900P 的算力結點,我們用網絡把資源連起來,可以給大家提供,告訴你這裏有資源可以通過網絡去用。

同時,我們還把華爲生態以外的,按照發改委的要求,希望這是異構的算力網的平台,我們也選擇了部分其他廠商的算力,在 2022 年 6 月這個項目驗收的時候,已經聚合的智能算力到了 2300P,雲腦 II 只是 1000P,這個系統已經聚集了 2300P 的智能算力。

我們有了雲腦 II 可以訓練大模型了,訓練大模型還是很費算力的,但是即使你可以訓練大模型,現在的需求根本不夠用,我們正在規劃做雲腦 III。

下面我說說大模型,鵬城正在做一個大模型,這個是 2000 億參數,也就是 200B 的參數,爲什么做這件事呢?

不用再花時間了,因爲有 Chat GPT 和類 Chat GPT 大模型在不停地湧現,同時因爲現在很多公司都用這個東西做產業應用,去做服務。所以,現在這個模型變得很重要了,但是現在有錢的公司可以砸幾個億做這樣的機器,甚至十幾個億和幾十個億,但是大多數的公司做不了。

這個領域需求這么大,怎么辦呢?

我們鵬城實驗室可以做一個底座,模型訓練完开放出去,大家在這個底座說做垂直應用。按照這樣的思路,我們首先有鵬城雲腦 II 的算力,前一階段我們積累了很多的數據,這一段時間前幾個月我們通過各個渠道,包括購买拿到數據,先下面做清洗,清洗的數據很重,可能我拿到了 100 個數據,清洗完就剩幾個了,因爲有很多是重復和不規範的,這些東西拿掉就變得很小。雖然拿了很多的數據,但是真正用來做訓練的數據只有 1%-5%。有了這個數據我們就可以做大模型底座。

這個大模型底座,我們就是用的生成式預訓練模型,就是和 GPT 完全類似的底層的東西,用這個東西訓練一個好的模型,希望可以开放出去。

現在這個模型我們想着 2000 億參數,200B 的參數,這個訓出來以後,我們希望把它給到合作夥伴那裏,而且提供相應的指令微調和相應的人工增強學習的工具,甚至做一兩個垂直領域,做樣板作爲垂直應用,怎么樣用告訴大家,因爲華爲在這方面很有經驗,我們建議誰想做垂直應用,可以到華爲得到一些咨詢用這個模型做他們的應用。

有了這個東西,我們希望能夠快速把這個模型做完可以推向社會,讓社會在這個模型上开發中國自己的人工智能大模型應用系統。現在我們正在緊鑼密鼓往前推,應該是 8 月底第一次所有的訓練就訓練完了,9 月份就會把模型开放出去。

現在訓練的數據有多大呢?我們說的是喂數據,每天喂 10 個 B,但是最重要喂一個 T 的數據,一個 T 是由幾百個 T 清洗來的,現在數據都是中文和代碼數據,現在 4000 多塊卡的機器每天可以喫掉 10 個 B,100 天就能喫掉 1000 個 B,就是一個 T,我訓練 2000 億參數的模型,需要 4000 塊卡訓練 100 天。

這就是算力,你如果不夠大的話,做一個模型還是很辛苦的,而且我現在才訓練了一個 T 的數據,訓練兩到三個 T 的話,還要加兩到三個 100 天,沒有大算力做大模型就是天方夜譚,當然有很多人說我可以用限速(音)等等這樣那樣的,但是實際上這就和電力是一樣的,可以省點電做出什么產品來,別人真正懂行的人聽了都不信的,一定要有算力作爲基礎。

我們的算力到現在爲止,怎么樣把數據做好訓練得快,我們有一套體系,有一個开源社區叫啓智开源社區,這裏面有很多的工程師做飛輪數據工程,可以使你清洗數據做得非常快,有很多自動和半自動的清洗數據,都可以幫助你。

模型訓練,4000 塊卡喫掉 10 個 B 的數據,整個的損失每天都在降一點,我 們看着特別高興,每天有數據匯報,一天降了 0.2,我們現在大概在 2 的上下浮動,我們希望最終可以降到 1.8 左右。

這是訓練的過程,同時我們要考慮應用的 時候有隱私數據有一些數據應用者,希望到你這個模型應用一下,但是不希望自己的數據被丟掉或者是看到,我們提供了隱私數據保護的模塊,我們叫防損包,有了這樣一套體系就可以支持應用了。

我們希望鵬城腦海出來了可以快速向社會賦能,可以讓大家做數字政府、“一帶一路”、智能制造、智慧金融、智慧醫療等等各種各樣可能的應用,這裏有黃顏色和白顏色,黃顏色是現在已經投進人去做了,你做指令微調和正向學習都需要。後面是放給合作夥伴去做的,而且我們還有一些完整的整個教育計劃、人才計劃,人才計劃就希望這個模型訓練放出來,大量培養人才,通過高校和合作夥伴培養,能讓中國的大模型應用快速啓動。

小結一下,鵬城實驗室在鵬城雲腦 II 硬件平台和鵬城腦海大模型這兩件事都在和華爲合作正在往前推進,希望可以對中國人工智能大模型用貢獻一點力量,作爲一個基石,希望大家多關心、多參與。

謝謝大家。

本文作者可以追加內容哦 !

鄭重聲明:本文版權歸原作者所有,轉載文章僅為傳播信息之目的,不構成任何投資建議,如有侵權行為,請第一時間聯絡我們修改或刪除,多謝。

標題:什么時候我們的算力超過美國,GDP也就可以超過美國了!

地址:https://www.breakthing.com/post/76023.html